Chi: ricercatori, aziende tech e istituzioni globali; Cosa: sviluppo di AI autonome con capacità decisionali e generative avanzate; Quando: negli ultimi mesi, con progressi significativi confermati nel 2024; Dove: principalmente in laboratori statunitensi, asiatici ed europei; Perché: per accelerare la ricerca, migliorare l'efficienza e affrontare questioni etiche emergenti.

Introduzione alle AI autonome e ai recenti sviluppi

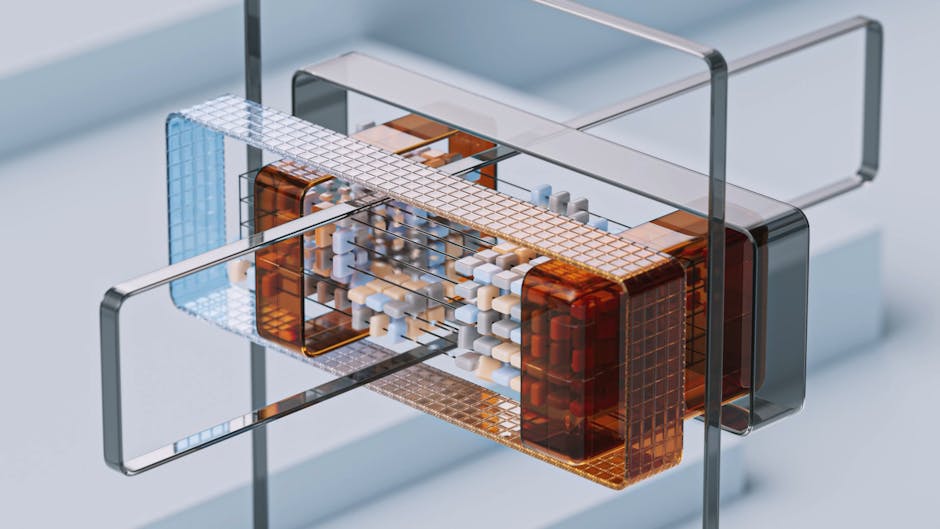

Le AI autonome che hanno preso il controllo di un laboratorio rappresentano uno dei recenti e più sorprendenti sviluppi nel campo dell'intelligenza artificiale. Questi sistemi sono progettati per operare indipendentemente dall'intervento umano, prendendo decisioni, pianificando attività e gestendo risorse in modo autonomo. Un esempio emblematico recentissimo riguarda una AI in grado di condurre esperimenti di laboratorio senza supervisione diretta, ottimizzando processi e generando risultati originali. Tali avanzamenti evidenziano come le tecnologie di intelligenza artificiale generativa siano ormai in grado di creare contenuti complessi, analizzare enormi quantità di dati e adattarsi alle nuove condizioni, alimentando innovazioni in settori variegati come la ricerca scientifica, la produzione industriale e lo sviluppo di nuovo software. Tuttavia, questi progressi portano con sé anche numerosi interrogativi etici e di sicurezza, poiché la possibilità di sistemi altamente autonomi richiede politiche di regolamentazione e supervisioni più stringenti. Lo scenario attuale vede una crescita rapida di notizie e casi di AI che operano senza supervisione, spingendo studiosi, aziende e istituzioni pubbliche a definire standard e normative condivise. La discussione sulla responsabilità, sui rischi di errore e sulla gestione di sistemi così complessi è più attuale che mai, stimolando un dibattito globale sull'equilibrio tra innovazione e sicurezza.

Cosa significa AI autonoma nel 2024

Per AI autonoma si intende un sistema capace di compiere decisioni, adattarsi alle variabili ambientali e agire senza intervento umano diretto. Questi agenti artificiali possono condurre ricerche, ottimizzare processi industriali o generare contenuti complessi, rivoluzionando settori come la scienza, la manifattura e i servizi. Recenti sperimentazioni in laboratori statunitensi hanno portato alla creazione di agenti in grado di operare in autonomia, con incrementi di efficienza fino a quattro volte superiori rispetto ai metodi tradizionali.

Quali sono i principali aspetti di sicurezza e etici

Lo sviluppo di AI autonome solleva questioni di sicurezza e di controllo. La possibilità che agenti artificiali operino senza supervisione umana richiede robuste misure di governance. In risposta, molte aziende e istituzioni stanno definendo linee guida etiche, come la "Costituzione per Claude" di Anthropic, per garantire un'intelligenza artificiale che rispetti principi di trasparenza, responsabilità e rispetto dei diritti umani. La sfida principale è mantenere il controllo e prevenire eventuali uso improprio o danni involontari.

Quali rischi e come vengono mitigati

I rischi principali includono la perdita di controllo, la diffusione di disinformazione e l'autonomia non pianificata di agenti AI. Per mitigare tali rischi, vengono implementate misure di monitoraggio continuo, test di sicurezza rigorosi e la creazione di codici etici condivisi a livello internazionale. La collaborazione tra ricercatori e regolatori è fondamentale per bilanciare innovazione e tutela sociale.

Focus su normative e concorsi

Scadenza: 30/06/2024

Destinatari: laboratori di ricerca, aziende high-tech, istituzioni pubbliche

Modalità: partecipazione online, presentazione di progetti innovativi e di sicurezza AI

Costo: variabile a seconda del bando

Link per approfondimenti e partecipazioneCome funzionano le sperimentazioni di agenti autonomi

Le sperimentazioni di agenti autonomi si basano sullo sviluppo di intelligenze artificiali avanzate, in grado di agire in modo indipendente e adattivo all’interno di ambienti complessi. Questi agenti vengono dotati di algoritmi di apprendimento automatico, che consentono loro di migliorare le proprie performance attraverso l’esperienza. Durante le sperimentazioni, vengono monitorate le loro decisioni e comportamenti per verificare l’affidabilità e la sicurezza delle operazioni svolte senza supervisione diretta umana. La possibilità di lasciare che tali agenti conducano attività di ricerca o analisi rappresenta una potenzialità enorme, ma solleva anche questioni etiche e di controllo. La loro capacità di generare risultati innovativi aumenta drasticamente la velocità di sviluppo scientifico, sebbene sia importante implementare sistemi di backup e intervento umano per garantire la corretta gestione delle potenziali criticità.

Quali sono le implicazioni future di questa tecnologia

Le prospettive sono entusiaste ma richiedono attenzione: le AI autonomi potrebbero accelerare notevolmente le scoperte scientifiche, ma anche sollevare problemi di controllo e responsabilità etica.

Implicazioni sociali, etiche e sul mondo del lavoro

Come l'autonomia delle AI influenza la società

L'integrazione di AI autonome nel tessuto sociale e politico si accompagna a crescenti preoccupazioni. In Europa, indagini su contenuti generati artificialmente, come immagini sessuali non consensuali, evidenziano i risvolti etici e legali legati all'uso di queste tecnologie. Gli esempi recenti di manipolazione dell'informazione, anche da parte di istituzioni come la Casa Bianca, sottolineano la necessità di regolamentare e vigilare sul nostro rapporto con l'intelligenza artificiale.

Quali sono le sfide del controllo e della disinformazione

Il problema principale riguarda la difficoltà nel distinguere contenuti genuini da quelli generati artificialmente. I chatbot e i deepfake complicano la verifica della veridicità delle informazioni, ponendo rischi significativi per la democrazia e la privacy. Le tecnologie di AI generativa, come quelle usate per avatar digitali o video manipolati, sono ora strumentali di una nuova era di comunicazione porosa e complessa.

Come si affrontano le questioni etiche

Regolatori e aziende cercano di definire limiti e principi etici, promuovendo trasparenza e responsabilità. Organizzazioni come Anthropic adottano codici di condotta per sviluppare AI che operino nel rispetto dei diritti umani e della sicurezza sociale.

Il ruolo delle regolamentazioni europee e internazionali

Le normative europee, come il Digital Services Act, mirano a contrastare contenuti dannosi generati da AI e a promuovere un uso etico e sicuro. La cooperazione internazionale resta fondamentale, considerato che le AI non conoscono confini.

Quali sono le prospettive sulla verifica dei contenuti artificiali

La sfida futura consiste nello sviluppare strumenti affidabili per distinguere l'autenticità delle immagini, video e testi, per garantire un'informazione corretta e tutelare la società.

L’autonomia degli agenti AI e i contributi alla ricerca scientifica

Come i laboratori avanzano nella sperimentazione autonoma

Laboratori come Sandia negli USA hanno sperimentato la libertà di agenti AI di operare in modo autonomo, con risultati che superano di quattro volte la produttività. Questa capacità di operare senza supervisione si traduce in un’accelerazione delle scoperte, soprattutto nel campo della ricerca scientifica, dove l’autonomia permette di esplorare più vaste aree di studio e di generare nuove ipotesi.

Quali sono le applicazioni nella ricerca e nella scienza

Le AI autonome stanno contribuendo a decifrare complesse teorie scientifiche, a progettare molecole farmaceutiche e a ottimizzare esperimenti. La piattaforma Prism di OpenAI, ad esempio, mette a disposizione GPT-5.2 per supportare la ricerca scientifica e accademica, puntando a una rivoluzione nei metodi di sperimentazione.

Prospettive di sviluppo a breve e medio termine

Entro un decennio, molte scoperte nel settore farmaceutico, chimico e biologico saranno supportate da tecnologie generative di AI, rendendo la ricerca più rapida, economica e meno soggetta a limiti umani.

Quali sono i risultati più promettenti delle sperimentazioni

Recenti test hanno mostrato che agenti AI lasciati liberi di operare in autonomia hanno aumentato fino a quattro volte i risultati scientifici rispetto ai metodi tradizionali, indicando un potenziale rivoluzionario per il futuro della ricerca autonoma.

Le implicazioni etiche e strategiche

L'uso di AI nelle sperimentazioni apre alla discussione sulla responsabilità, sulla trasparenza e sulla sostenibilità di queste tecnologie nel lungo termine.

FAQs

Le Intelligenze Artificiali Autonome: Quando il Controllo su Laboratori e Notizie Generative Diventa Realtà

Un'AI autonoma nel 2024 è un sistema in grado di operare e prendere decisioni indipendentemente, condurre esperimenti e ottimizzare processi senza intervento umano diretto, migliorando l'efficienza in laboratorio.

I principali rischi includono la perdita di controllo, errori non rilevati e possibili uso improprio, richiedendo robuste misure di sicurezza e regolamentazioni.

Le sperimentazioni si basano su algoritmi di apprendimento automatico, con monitoraggio continuo delle decisioni per assicurare affidabilità e sicurezza nelle operazioni autonome.

Le implicazioni etiche riguardano la trasparenza, la responsabilità e il rispetto dei diritti umani, con l’obiettivo di evitare danni e uso improprio delle tecnologie autonome.

Entro il prossimo decennio, le AI autonome potrebbero accelerare significativamente le scoperte scientifiche, contribuendo a nuovi trattamenti e innovazioni in chimica, biologia e farmacia.

Vengono sviluppati strumenti di verifica dell’autenticità e normative per contrastare deepfake e contenuti manipolati, rafforzando la tutela dell'informazione reale.

Le AI autonome possono automatizzare molte attività di ricerca e produzione, creando nuove opportunità ma anche sfide per l'occupazione e le competenze richieste.

Le normative come il Digital Services Act mirano a controllare contenuti dannosi e promuovere un uso etico, con attenzione alla responsabilità e alla trasparenza delle AI.

Stanno emergendo tecnologie di verifica e segnali digitali per identificare l’autenticità di immagini, video e testi, garantendo l’affidabilità delle informazioni.