CHI: Dipendenti di aziende come Google, OpenAI e Anthropic

COSA: Solidarietà pubblica contro le pressioni governative sul settore dell'intelligenza artificiale

QUANDO: A partire dal 2 marzo 2026 e negli eventi successivi

DOVE: Negli Stati Uniti, a livello internazionale tramite manifestazioni e lettere aperte

PERCHÉ: Per difendere principî etici e l’autonomia del settore AI di fronte a pressioni militari e governative

- Un’ondata di supporto fra i professionisti dell'AI in risposta alle pressioni militari del Dipartimento della Difesa USA

- Mobilitazione etica e unione tra i lavoratori per respingere le richieste di sviluppare sistemi d’arma autonomi

- La lettera "We Will Not Be Divided" simbolo di resistenza contro pressioni divisive e minacce economiche

Normativa e bandi di interesse

Destinatari: professionisti dell’AI, aziende tecnologiche, enti etici e governi

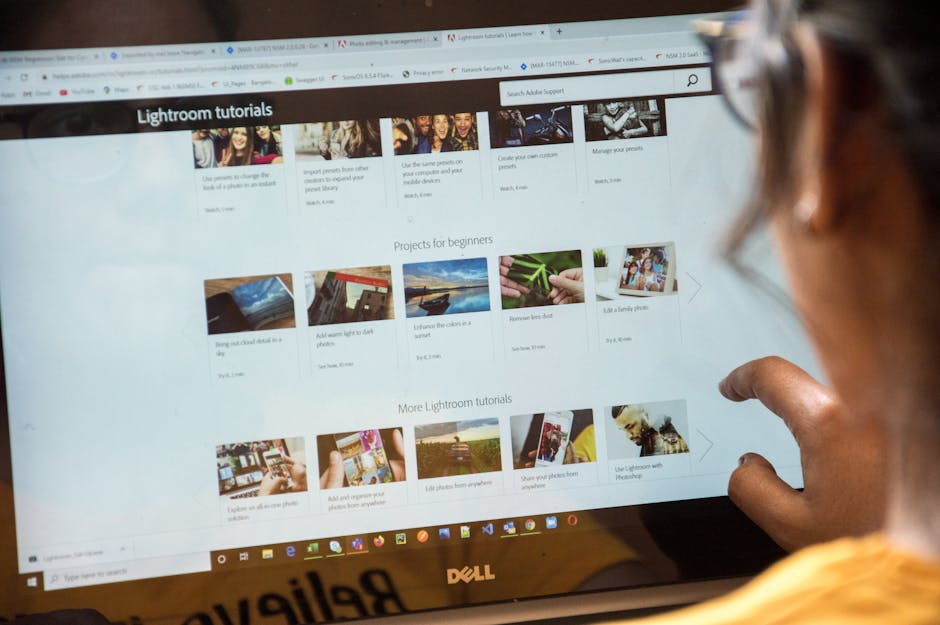

Modalità: partecipazione tramite lettere di sostegno, petizioni, mobilitazioni pubbliche

Costo: gratuito, a livello di impegno civico e professionale

Contestazione del coinvolgimento militare e unità etica nel settore dell'AI

Lo scontro col Pentagono ha scatenato un’ondata di supporto ad Anthropic fra i dipendenti dell’AI, portando alla luce il dibattito interno sulla responsabilità etica delle aziende nel settore dell’intelligenza artificiale. Diverse figure professionali, timorose di essere coinvolte in progetti che possano essere usati per scopi militari o di sorveglianza, hanno espresso pubblicamente la loro opposizione e preoccupazione, sottolineando l’importanza di mantenere un’etica rigorosa nel sviluppo delle tecnologie. Questi lavoratori ritengono che le scelte strategiche delle imprese debbano essere guidate non solo da considerazioni commerciali, ma anche da principi morali fondamentali. La pressione degli ambienti pubblici e privati può spesso spingere le aziende a piegarsi alle richieste militari, ma una crescente consapevolezza ha incoraggiato professionisti di diversi settori ad affermare pubblicamente la necessità di rispettare i valori etici universali. La loro iniziativa si traduce in un movimento di unità e impegno, che mira a garantire che lo sviluppo dell’AI avvenga nel rispetto dei diritti umani, della privacy e della non violenza, contribuendo a creare un settore più eticamente consapevole e responsabile. Questa dinamica rappresenta un nuovo paradigma di responsabilità morale all’interno dell’industria tecnologica, spingendo le aziende a considerare più attentamente le implicazioni etiche delle proprie strategie di innovazione.

Le ragioni della protesta etica

Il cuore del dissenso risiede nella volontà di preservare l’autonomia delle aziende nel definire le proprie politiche etiche e nell’opporsi a un modello di sviluppo tecnologico che possa essere utilizato per scopi militari o di sorveglianza dei cittadini. La pressione del governo americano, rappresentata dall’ultimatum del 2 marzo 2026, ha infatti scatenato un dibattito acceso sui limiti morali e legali dell’utilizzo dell’AI.

I dipendenti che si sono schierati si rendono conto che questa mobilitazione rappresenta una sfida al tradizionale rapporto tra settore pubblico e aziende private, puntando a un’etica condivisa e a una responsabilità collettiva.

Come si manifesta la solidarietà

Le manifestazioni di supporto sono avvenute principalmente attraverso lettere aperte, come quella intitolata *"We Will Not Be Divided"*, firmata da più di 300 professionisti. Questa lettera denuncia le strategie di pressione, definendole divisive e potenzialmente dannose per la reputazione e la credibilità del settore.

I firmatari invitano inoltre le grandi aziende a opporsi alle richieste che minano i principi di indipendenza etica, come il rifiuto di sviluppare sistemi di sorveglianza o armi autonome senza supervisione umana.

Normativa e bandi di interesse

Normativa e bandi di interesse: La crescente attenzione verso le questioni etiche e di sicurezza nell’intelligenza artificiale ha portato allo sviluppo di normative e bandi di finanziamento mirati a sostenere l’innovazione responsabile nel settore. In particolare, lo scontro col Pentagono ha scatenato un’ondata di supporto ad Anthropic fra i dipendenti dell’AI, evidenziando l’importanza di politiche pubbliche che tutelino i valori etici e i diritti dei cittadini. Diverse agenzie europee e nazionali hanno emanato regolamenti che incentivano progetti di AI trasparenti e rispettosi della privacy, stabilendo standard minimi di conformità per le aziende del settore. Allo stesso tempo, numerosi bandi di finanziamento pubblici e privati sono disponibili per sostenere startup e istituzioni che si impegnano nello sviluppo di soluzioni AI etiche ed inclusive. La partecipazione a questi bandi e la conformità alle normative rappresentano un’opportunità importante per le aziende di posizionarsi come leader responsabili, rafforzando la propria reputazione e contribuendo allo sviluppo sostenibile dell’intelligenza artificiale. È fondamentale quindi rimanere aggiornati sulle novità legislative e promuovere iniziative che favoriscano un’adozione etica della tecnologia.

Il ruolo dei grandi player

Lo scontro col Pentagono ha scatenato un’ondata di supporto ad Anthropic fra i dipendenti dell’AI, evidenziando l’importanza di un’indipendenza nell’ambito della ricerca e dello sviluppo di tecnologie avanzate. Le grandi aziende del settore, come Google e OpenAI, sono chiamate a unirsi ad Anthropic nel respingere pressioni che potrebbero compromettere i valori etici condivisi, promuovendo un approccio più trasparente e responsabile. Questa alleanza tra professionisti e aziende rappresenta un passo fondamentale verso la creazione di un settore AI eticamente responsabile, in cui le decisioni siano guidate non solo da obiettivi commerciali, ma anche da principi morali che tutelano la società nel suo complesso. La solidarietà tra i dipendenti e le aziende contribuisce a mantenere elevati gli standard etici e a favorire un dialogo aperto e costruttivo sulla direzione futura dell’intelligenza artificiale.

Prospettive future

Lo scontro col Pentagono ha scatenato un’ondata di supporto ad Anthropic fra i dipendenti dell’AI, evidenziando una forte coesione interna e una crescente attenzione alle implicazioni etiche delle tecnologie emergenti. Questa mobilitazione potrebbe portare a un cambiamento significativo nella definizione delle politiche di investimento e regolamentazione nel settore, favorendo un dibattito più aperto e inclusivo sulle responsabilità delle aziende di intelligenza artificiale. Inoltre, la solidarietà tra professionisti potrebbe incentivare lo sviluppo di pratiche più trasparenti e orientate alla tutela dei diritti umani, promuovendo un’avanzata sostenibile e eticamente consapevole nel campo dell’IA. È probabile che queste dinamiche influenzino anche le strategie di collaborazione internazionale, contribuendo a costruire standard condivisi e a rafforzare l’impegno verso un futuro tecnologico più equo e responsabile.

FAQs

Lo scontro tra Anthropic e il Pentagono: una crescente solidarietà tra i professionisti dell'AI

Lo scontro ha scatenato un'ondata di supporto fra i dipendenti di Anthropic, rafforzando la coesione interna e la mobilitazione etica contro le pressioni militari.

I professionisti hanno mostrato solidarietà attraverso lettere aperte, come "We Will Not Be Divided", e hanno espresso opposizione a sviluppi militari senza supervisione etica.

Le aziende come Google e OpenAI stanno sostenendo Anthropic, promuovendo pratiche trasparenti e opponendosi allo sviluppo di sistemi d’arma autonomi senza supervisione umana.

Le lettere aperte, come "We Will Not Be Divided", firmate da oltre 300 professionisti, sono il principale gesto di solidarietà contro le pressioni divisive.

I dipendenti vogliono preservare l’autonomia etica delle aziende e opporsi a progetti militari o di sorveglianza che compromettono i valori morali fondamentali.

Le normative europee e nazionali promuovono trasparenza e rispetto della privacy, mentre bandi pubblici e privati finanziano progetti etici, sostenendo l’innovazione responsabile.

Il sostegno interno e le proteste pubbliche stanno alimentando un movimento di responsabilità morale, influenzando le politiche di investimento e regolamentazione.

La solidarietà potrebbe portare a nuove politiche più etiche e a una maggiore collaborazione internazionale, promuovendo un settore AI più responsabile e sostenibile.