Implicazioni pratiche e piano di adozione per scuole

Una governance chiara, policy di utilizzo e formazione mirata sono elementi chiave per trasformare potenzialità tecnologiche in azioni concrete. È fondamentale definire ruoli, responsabilità e procedure, assicurando che l’IA supporti gli obiettivi educativi senza compromettere la privacy o la sicurezza dei dati degli studenti. La transizione deve essere accompagnata da un calendario realistico, indicatori di successo e strumenti di monitoraggio continuo.

L’approccio operativo si basa su tre assi: responsabilità, strumenti adeguati e misure di controllo. In pratica significa selezionare strumenti affidabili, curare l’implementazione tecnica e mettere in atto verifiche periodiche su usi, risultati e impatti sull’organizzazione scolastica. L’obiettivo è creare una cultura della trasparenza, della valutazione critica e della responsabilità condivisa tra docenti, ATA e dirigenti.

Nel contesto scolastico, l’adozione di un potente modello AI come DeepSeek V4 richiede una pianificazione accurata che integri tecniche di privacy by design, gestione del consenso informato di genitori e studenti ove richiesto, e audit periodici delle prestazioni. È essenziale definire chi può accedere agli insight generati dall’IA, come vengono memorizzati i log di utilizzo e come vengono gestite le modifiche ai profili degli studenti. Inoltre, è opportuno prevedere meccanismi di rollback in caso di impatti non desiderati e un piano di continuità operativa.

- Definizione delle finalità didattiche e scenari di utilizzo, con responsabilità chiare per docenti, dirigenti e personale ATA

- Valutazione della conformità legale e contrattuale, inclusa privacy e sicurezza dei dati

- Scelta di strumenti affidabili e compatibili con l’infrastruttura esistente; preferire soluzioni che offrano opzioni di data minimization e processing locale

- Progettazione e gestione del pilota su gruppi limitati di classi, con metriche di apprendimento e percezione degli studenti

- Formazione mirata per docenti e personale di supporto

- Definizione di indicatori di successo e meccanismi di monitoraggio continuo

- Policy di sicurezza, controllo degli accessi, cifratura dei dati e piani di risposta agli incidenti

- Comunicazione trasparente con studenti, genitori, e corpo docente; descrizione chiara delle condizioni di utilizzo

- Governance dei dati: chi decide cosa viene conservato, per quanto tempo e come viene eliminato

- Strategia di scalabilità e gestione delle licenze/acquisti

In sintesi, l’adozione pratica richiede una sinergia tra governance, formazione e strumenti, con una cultura della valutazione critica e della responsabilità condivisa, per trasformare la potenzialità tecnologica in azioni didattiche efficaci senza compromettere la tutela della privacy e la sicurezza dei dati.

Per i docenti

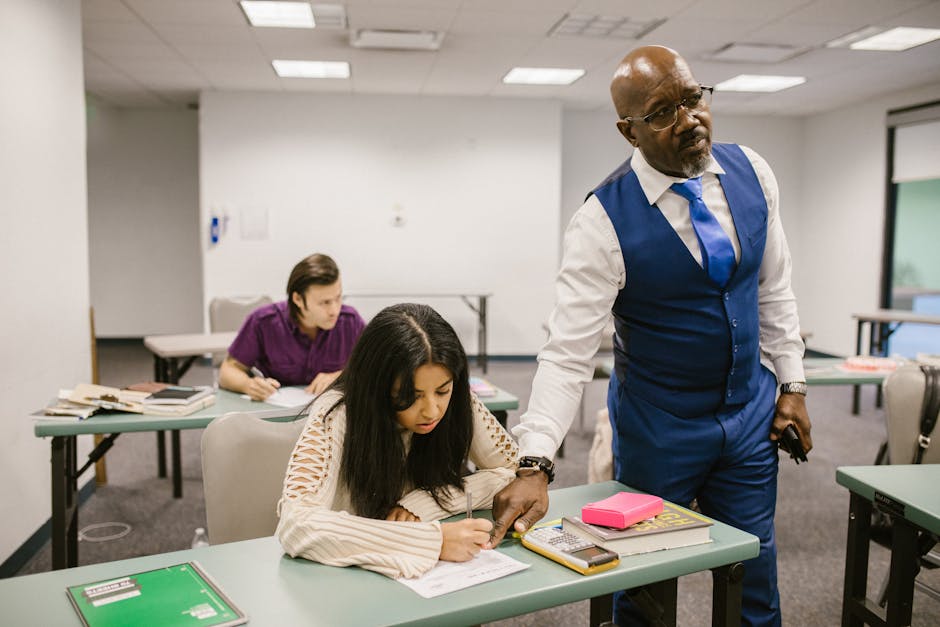

Per integrare efficacemente l’IA in classe, i docenti devono chiarire obiettivi e ruoli, riconoscendo che strumenti come DeepSeek V4 possono supportare, ma non sostituire, l’apprendimento umano. Le attività guidate dall’IA possono accelerare l’accesso a informazioni, facilitare bozze di lavoro e stimolare la generazione di idee; è cruciale accompagnare i ragazzi nel processo di interpretazione critica, confronto tra fonti e verifica dell’accuratezza. L’obiettivo è potenziare le competenze degli studenti e guidarli attraverso nuove frontiere della conoscenza, mantenendo sempre una cornice etica e pedagogica ben definita.

La cornice operativa dovrebbe distinguere chiaramente tra attività didattiche supportate dall’IA e compiti che richiedono creatività o problem solving autonomo. A livello di progettazione didattica, è utile definire:

- Obiettivi di apprendimento chiari e criteri di valutazione per le attività con IA.

- Ruoli degli studenti: esplorazione guidata, verifica critica, rielaborazione originale.

- Ruolo dell’insegnante: facilitare il ragionamento, correggere errori, discutere etica e bias.

- Procedure di verifica: checkpoint per valutare l’accuratezza delle risposte generate.

- Linee guida su privacy e uso responsabile: non condividere dati sensibili, citare fonti e rispettare i diritti d’autore.

In pratica, le attività di lezione dovrebbero seguire un ciclo di lavoro iterativo: primo, presentare il problema o l’obiettivo; secondo, permettere agli studenti di utilizzare l’IA per raccogliere dati e generare bozze; terzo, analizzare criticamente l’output con l’aiuto dell’insegnante; quarto, rielaborare i contenuti in forma originale; quinto, discutere di etica, affidabilità e bias; sesto, valutare sia il processo sia il prodotto finale. Questo approccio aiuta gli studenti a sviluppare pensiero critico, autonomia e responsabilità digitale.

Infine, è essenziale che le scuole offrano opportunità di sviluppo professionale per i docenti: formazione sull’uso pedagogico dell’IA, workshop su valutazione critica, scenari etici e condivisione di casi di studio tra colleghi. Una cultura di fiducia e riflessione continua facilita l’integrazione sicura ed efficace di strumenti come DeepSeek V4, garantendo che la tecnologia sostenga, e non sostituisca, la qualità dell’apprendimento.

In conclusione, l’obiettivo è mettere gli studenti al centro del processo di apprendimento, con i docenti come guide attente che sanno valorizzare le potenzialità dell’IA, verificare l’accuratezza delle informazioni e promuovere una pratica educativa responsabile e innovativa.

Il veloce avanzare di IA avanzate come Hunter Alpha e DeepSeek V4 sta trasformando i contesti educativi. Questo articolo propone un piano operativo, orientato a etica, governance e competenze, utile a docenti, dirigenti e ATA per utilizzare in modo responsabile strumenti complessi senza rinunciare alla qualità educativa.

Questo contenuto integrativo amplia la tabella precedente offrendo una cornice operativa per l’uso responsabile di strumenti basati su IA in contesto educativo. Si focalizza su etica, governance e sviluppo delle competenze, con indicazioni pratiche destinate a docenti, dirigenti e personale ATA per utilizzare strumenti complessi senza compromettere la qualità dell’insegnamento.

- Etica: principi di trasparenza e spiegabilità, protezione della privacy, minimizzazione dei dati, mitigazione di bias e responsabilità chiara per le decisioni supportate dall’IA.

- Governance: policy di utilizzo, ruoli e responsabilità, controlli di conformità, piani di sicurezza informatica, audit periodici e procedure di incident response.

- Competenze: alfabetizzazione digitale, pensiero critico nell’interpretazione degli output IA, formazione continua per docenti e personale, integrazione pedagogica dell’IA senza sostituire la pedagogia tradizionale.

In ambito educativo, l’implementazione operativa deve includere una gestione olistica della qualità: definire finalità didattiche, valutare l’impatto sull’apprendimento, stabilire limiti di utilizzo in classe e prevedere momenti di riflessione per docenti e studenti.

- Linee guida per docenti: utilizzare strumenti IA come supporto alla progettazione didattica, controllare affidabilità delle fonti e assicurare la supervisione umana sui contenuti generati.

- Linee guida per dirigenti: assicurare coerenza con il PTOF, definire budget per formazione e strumenti, predisporre procedure di revisione periodica delle policy.

- Linee guida per ATA: gestire accessi, sicurezza dati, backup, supporto tecnico e gestione delle emergenze legate all’uso degli strumenti IA.

Approccio operativo in tre fasi: 1) audit e selezione: mappare strumenti potenzialmente impattanti, valutare conformità etica e di sicurezza; 2) implementazione controllata: avviare progetti pilota con monitoraggio e formazione mirata; 3) monitoraggio e adattamento: analizzare risultati didattici, aggiornare policy e modulare l’uso in base al feedback.

Riflettendo sul contesto tecnologico, la domanda "Un potente e misterioso modello AI cinese si sta diffondendo fra gli sviluppatori: è DeepSeek V4?" richiama l’importanza di verificare fonti affidabili e di basare le scelte su criteri oggettivi. In ambito educativo, è essenziale distinguere tra novità tecnologiche e valore pedagogico reale, evitando passi dettati dall’hype.

In sintesi, l’integrazione di IA avanzate richiede una collaborazione strutturata tra docenti, dirigenti e ATA, guidata da etica, governance chiara e sviluppo di competenze. Con una pianificazione dettagliata, policy robuste e formazione continua, le scuole possono utilizzare strumenti complessi in modo responsabile senza compromettere la qualità educativa.

Valutazione critica degli strumenti

Valutazioni di governance e controllo dell'uso — Oltre ai criteri di affidabilità, è utile definire chi è responsabile delle decisioni sull'uso dello strumento, come si gestiscono le eccezioni didattiche e quali processi di revisione periodica sono previsti. Si raccomanda di stabilire criteri di accettazione, metriche di successo e un piano di gestione dei rischi che includa responsabilità, escalation e tempistiche di rivalutazione.

- Ruoli e responsabilità — chi decide sull'attivazione, chi monitora l'uso in aula, chi gestisce i dati e cosa fare in caso di problemi.

- Processi di valutazione continua — iterazione basata su feedback, revisioni periodiche delle prestazioni e aggiornamenti programmati.

- Trasparenza operativa — disponibilità di informazioni chiave ai docenti e agli studenti sulle finalità e limiti.

Aspetti di sicurezza, privacy e conformità — l'adozione deve includere misure concrete per proteggere i dati degli studenti, minimizzare i dati raccolti e fornire strumenti per la gestione delle preferenze e delle cancellazioni.

- Sicurezza dei dati — cifratura a riposo e in transito, controllo degli accessi, audit trail e protezione contro accessi non autorizzati.

- Conformità normativa — allineamento a normative locali e alle policy della scuola, inclusa la gestione del consenso e dei diritti degli interessati.

- Conservazione e portabilità — definire tempi di conservazione, modalità di esportazione dei dati e procedure di cancellazione sicura.

- Interoperabilità — integrazione stabile con LMS e sistemi esistenti, uso di API autorizzate e standard aperti.

- Valutazione della bias e della qualità dei dati — test periodici per individuare e mitigare discriminazioni o distorsioni nei dataset.

Verifica pratica — prima di un roll-out completo, condurre prove pilota su gruppi ristretti, monitorare prestazioni, raccogliere feedback e documentare le azioni correttive necessarie.

Definizione di limiti didattici

Definire i limiti didattici richiede una chiara cartografia di ciò che l’IA può offrire in classe e di dove intervenga l’insegnante per garantire l’apprendimento significativo. È utile distinguere tra attività di supporto al contenuto, rilevazione delle lacune, automazione di compiti ripetitivi e strumenti di valutazione, stabilendo criteri concreti di quando l’IA può proporre contenuti, suggerimenti o correzioni e quando è necessaria la verifica umana. In ogni ambito, la verifica finale e l’interpretazione critica rimangono responsabilità dell’insegnante.

- Chiarezza sui ruoli tra IA e docente: dove l’IA propone spunti o risposte e dove interviene la guida umana;

- Gestione dei dati: quali dati degli studenti sono trattati, dove sono conservati e per quanto tempo;

- Trasparenza: spiegare agli studenti come e perché l’IA genera determinati suggerimenti o feedback;

- Controlli sui rischi: misure per prevenire dipendenza tecnologica, bias e errori;

- Aggiornamento delle regole: revisioni periodiche delle politiche didattiche in base all’esperienza di classe.

Le prove pilota dovrebbero includere una combinazione di osservazioni qualitative e indicatori quantitativi: effetti sull’apprendimento, gestione della classe, partecipazione degli studenti e carico di lavoro degli insegnanti, con un piano di scalabilità basato su risultati concreti e disponibilità di risorse.

La formazione continua è parte integrante della definizione di limiti: offrire moduli su etica, privacy, interpretazione critica e uso efficace della tecnologia in contesto didattico; predisporre risorse e tempi adeguati per l’aggiornamento del personale.

In contesti di modelli avanzati che circolano tra gli sviluppatori, come accade con riferimenti a DeepSeek V4, una governance chiara e una cultura della responsabilità condivisa tra docenti, personale ATA e dirigenti diventano essenziali per mantenere l’uso dell’IA incentrato sull’apprendimento e sulla tutela degli studenti.

Infine, la definizione di limiti didattici deve accompagnarsi a una revisione continua delle pratiche e a una comunicazione aperta con studenti e famiglie, in modo che l’IA resti uno strumento di supporto e non un sostituto della supervisione educativa.

FAQs

Come introdurre l’IA nelle scuole: piano pratico per docenti, ATA e dirigenti

Informazione non disponibile al 18/03/2026. Non ci sono fonti ufficiali pubbliche che descrivano DeepSeek V4, le sue specifiche e le applicazioni restano non confermate.

Informazione non disponibile al 18/03/2026. Attualmente non esistono fonti affidabili che documentino una diffusione diffusa; per capire l’eventuale adozione, vale monitorare forum di settore e annunci da fornitori.

Se si considerasse l’adozione, i criteri chiave includono provenienza affidabile, trasparenza dei dati di addestramento, gestione della privacy e audit di conformità. È necessario definire governance, rischi e piani di mitigazione, oltre a prove pilota controllate.

Le scuole e gli sviluppatori dovrebbero monitorare fonti ufficiali e adottare una governance chiara; privilegiare pilot e valutazioni di impatto prima di un’adozione diffusa. È fondamentale garantire privacy, sicurezza dei dati e supervisione umana nelle fasi di sperimentazione e deployment.