OpenAI, dopo aver collaborato con il Dipartimento della Difesa degli Stati Uniti, sta considerando di sviluppare un accordo con la NATO per l'uso dell’intelligenza artificiale in ambito militare. Questa decisione rappresenta un passo importante nel rapporto tra tecnologia e sicurezza internazionale, evidenziando le potenzialità e le sfide di applicare l’AI alle strategie di difesa condivise tra gli alleati dell’Alleanza Atlantica. La notizia si è diffusa attraverso dichiarazioni ufficiali e dibattiti interni tra i dirigenti dell’azienda, con il coinvolgimento diretto di rappresentanti della NATO e delle istituzioni militari europee.

Potenziale collaborazione tra OpenAI e l’Alleanza Atlantica

La prospettiva di una collaborazione tra OpenAI e l’Alleanza Atlantica apre nuovi scenari per l’uso dell’intelligenza artificiale nelle attività di sicurezza e difesa. Questa iniziativa potrebbe favorire lo sviluppo di sistemi AI integrati e sicuri, in grado di migliorare la pianificazione strategica, la sorveglianza e il coordinamento delle operazioni militari tra i paesi membri della NATO. La condivisione di tecnologie e dati all’interno dell’Alleanza potrebbe accelerare l’innovazione e garantire una risposta più efficace alle minacce emergenti, dai conflitti cibernetici alle minacce ibride. Inoltre, un simile accordo potrebbe stabilire standard comuni per l’impiego dell’AI in ambito militare, promuovendo pratiche etiche e di sicurezza condivise. La collaborazione con OpenAI permetterebbe all’Alleanza di usufruire di tecnologie all’avanguardia, sfruttando la ricerca nel campo dell’intelligenza artificiale per proteggere meglio i propri membri e mantenere un vantaggio strategico rispetto a potenziali aggressori. Questi sviluppi testimoniano l’importanza crescente dell’AI come componente chiave nelle future strategie di difesa collettiva e sicurezza internazionale.

Come funzionerebbe la collaborazione

Se l’accordo venisse concretizzato, la collaborazione tra OpenAI e la NATO potrebbe rappresentare un passo significativo nell’integrazione dell’intelligenza artificiale nelle operazioni militari e di sicurezza dell’Alleanza. La collaborazione si baserebbe sull’uso di modelli avanzati di AI per supportare decisioni in tempo reale, analizzare grandi quantità di dati provenienti da diverse fonti, e migliorare la precisione delle predizioni strategiche. Questi strumenti potrebbero essere impiegati anche per il monitoraggio delle aree di crisi, la gestione delle crisi umanitarie e la prevenzione di attacchi informatici, rafforzando così le capacità di risposta della NATO. Inoltre, l’accordo prevederebbe l’adozione di rigorosi protocolli di sicurezza e di etica, per garantire che l’uso dell’AI militare rispetti i diritti umani e le normative internazionali. Questo include il rispetto delle restrizioni sull’automazione delle decisioni di vita o di morte, promuovendo una supervisione umana continua. La collaborazione potrebbe inoltre favorire uno scambio di competenze e tecnologie tra OpenAI e le forze armate alleate, rafforzando la capacità dell’Alleanza di sviluppare e adattare strumenti di AI avanzati in modo responsabile, trasparente e sicuro, in linea con gli obiettivi di sicurezza collettiva e di stabilità globale.

Quali aree di applicazione

Quali aree di applicazione

Dopo il Pentagono, anche la NATO sta valutando l'adozione di tecnologie di intelligenza artificiale avanzata per rafforzare le proprie capacità operative e strategiche. L’integrazione dell’AI si concentra su diverse aree chiave che possono migliorare significativamente l’efficacia e la rapidità delle decisioni militari. Una delle principali applicazioni riguarda la cybersecurity: l’AI può essere impiegata per monitorare e proteggere reti e sistemi di comunicazione militari, identificando tempestivamente potenziali minacce informatiche e intrusioni, e automatizzando risposte rapide per limitare i danni. In ambito logistico, l’intelligenza artificiale permette di ottimizzare la gestione delle risorse, pianificando le rotte di trasporto e le scorte, migliorando l’efficienza delle operazioni di supporto e riducendo i tempi di risposta alle emergenze. Quanto all’intelligence, l’AI aiuta l’analisi di grandi volumi di dati provenienti da fonti diverse, facilitando la sorveglianza strategica e il riconoscimento precoce di minacce emergenti. Inoltre, l’AI può essere applicata nello sviluppo di sistemi autonomi e droni militari, migliorando la capacità di riconoscimento, monitoraggio e intervento sul campo. Grazie a queste tecnologie, la NATO mira a rafforzare la propria deterrenza e capacità di intervento rapido, garantendo una maggiore sicurezza collettiva in un contesto di minacce in continua evoluzione.

Reazioni e critiche alla proposta di accordo

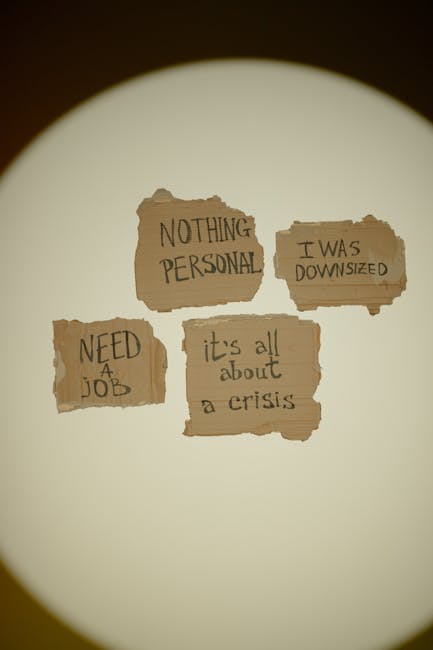

Le reazioni alla proposta di accordo tra OpenAI e la NATO sono state molto variegate e hanno alimentato un acceso dibattito a livello internazionale. Mentre alcuni esperti sostengono che l'integrazione dell’intelligenza artificiale nelle pratiche militari possa aumentare l’efficienza e migliorare la risposta alle crisi, altri avanzano forti preoccupazioni riguardo ai potenziali rischi di escalation e di accidentalità. Le critiche si focalizzano anche sulla mancanza di un quadro normativo globale chiaro e condiviso, che possa garantire l’uso responsabile delle tecnologie avanzate. Questa situazione ha acceso interessi sia tra sostenitori della tecnologia militare innovativa che tra gruppi di attivisti e organizzazioni internazionali impegnate nella regolamentazione dell’AI, rendendo il dibattito molto complesso e controverso. In questo contesto, sono emerse richieste di trasparenza e di un quadro di regole internazionale che possa prevenire potenziali rischi e favorire un utilizzo etico e responsabile dell’intelligenza artificiale in ambito militare.

Implicazioni etiche e futuribili

Inoltre, è essenziale considerare le possibili conseguenze di un’accelerazione nel progresso dell’AI militare, che potrebbero portare a una corsa agli armamenti automatizzati con rischi elevati di escalation e errori di interpretazione. La comunità internazionale si trova di fronte alla sfida di stabilire normative e accordi per evitare che tali tecnologie vengano utilizzate senza un adeguato controllo etico e diplomatico. Il dibattito riguarda anche la responsabilità in caso di decisioni autonome di sistemi di IA coinvolti in conflitti, sollevando questioni sulla trasparenza, la supervisione e la governance globale di queste tecnologie avanzate. In futuro, potrebbe essere necessario un quadro normativo condiviso per garantire che lo sviluppo e l’uso dell’AI militare siano alignati con i principi di pace, sicurezza e rispetto dei diritti umani.

FAQs

Dopo il Pentagono, la NATO: OpenAI valuta un accordo sull’intelligenza artificiale militare

OpenAI sta considerando di sviluppare un accordo con la NATO per l'uso dell'intelligenza artificiale in ambito militare, dopo aver collaborato con il Dipartimento della Difesa degli Stati Uniti.

La collaborazione dovrebbe basarsi sull'uso di modelli di AI avanzati per supportare decisioni in tempo reale, analizzare dati e migliorare le capacità di sorveglianza e intervento militare, rispettando protocolli di sicurezza ed etica.

Le aree principali includono cybersecurity, logistica, intelligence, monitoraggio delle crisi e sviluppo di sistemi autonomi come droni militari, per potenziare la deterrenza e la risposta rapida.

Le reazioni variano da sostenitori che vedono un potenziamento della sicurezza a critici preoccupati per rischi di escalation, con richieste di maggiore trasparenza e regolamentazione internazionale.

Esistono rischi di escalation, decisioni autonome potenzialmente pericolose e mancanza di regolamentazione condivisa, sollevando questioni su responsabilità, trasparenza e conformità etica in ambito militare.

Potrebbe portare a una corsa agli armamenti automatizzati, con rischi di escalation e decisioni non umane, richiedendo norme condivise per un uso responsabile e etico dell’AI in difesa.

Informazione non disponibile al 27/04/2024. Non ci sono date ufficiali su una possibile firma dell’accordo.

Le sfide includono lo sviluppo di sistemi sicuri, affidabili, trasparenti e rispettosi dei diritti umani, oltre alla creazione di standard comuni tra i paesi membri.