A margine della GTC Nvidia in California

Jensen Huang, nell’intervista per Mad Money, presenta OpenClaw

“il next ChatGPT”: agenti AI autonomi con poco codice

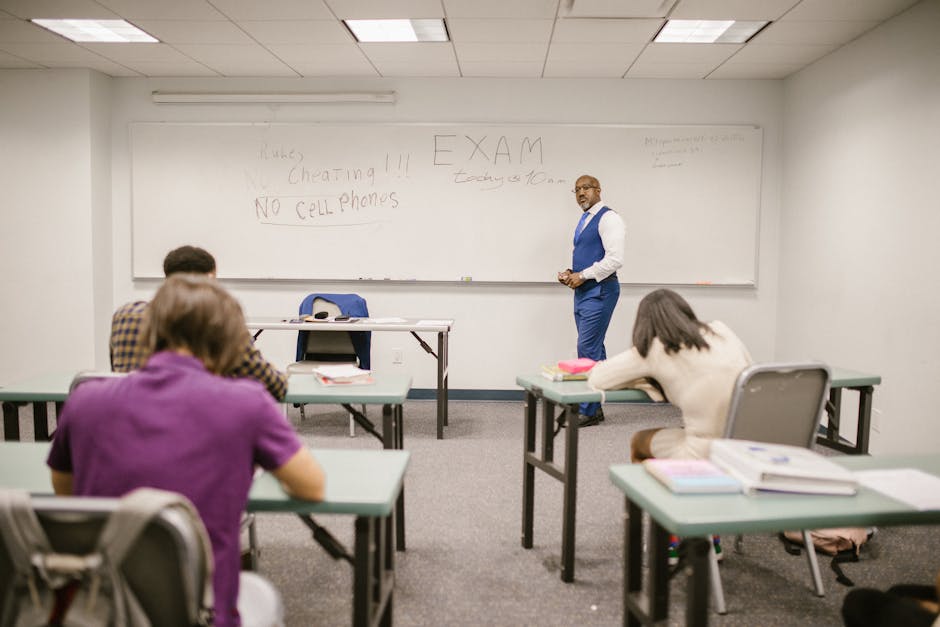

Per la scuola servono pilota, policy e controllo umano per privacy e responsabilità

Tabella operativa: chi fa cosa per usare OpenClaw a scuola

| Ruolo | Cosa fare | Tempistica | Output atteso |

|---|---|---|---|

| Docenti | Pilota 1 attività, con dati anonimi e prompt salvati; revisione umana prima di qualunque uso con studenti | Entro 2 settimane | 1 scheda con criterio di qualità + note su errori e limiti |

| Team digitale / Animatore | Verifica flussi di dati e accessi; crea ambiente di test separato e definisci dove restano log e output | Entro 30 giorni | Report sicurezza/privacy + elenco permessi e procedure di ripristino |

| Dirigente / DSGA | Definisce regole: bozze sì e decisioni no; autorizza chi costruisce agenti e fissa responsabilità operative | Entro 45 giorni | Policy interna + procedura per approvazione, log e casi di stop |

| DPO / Privacy | Valuta base giuridica e impatti quando l’agente esegue azioni; indica vincoli su dati, tempi e consultazione | Entro 45 giorni | Parere DPO documentato + misure richieste |

| Segreteria / ATA | Usa solo bozze e comunicazioni; invia manualmente; archivia evidenze e versioni secondo le vostre procedure | Entro 60 giorni | Template revisionati + registro prove (prompt, output, approvazione) |

| Collegio docenti | Approva 3 casi d’uso e limiti (niente dati sensibili, controllo sempre); decide quali output diventano materiali didattici | Alla prossima delibera | Verbale + allegato operativo con criteri e divieti |

OpenClaw e NemoClaw: cosa chiedere prima di far lavorare l’agente

Con OpenClaw gli agenti AI escono dalla chat e diventano workflow con poco codice. A scuola la regola è controllo umano e domande chiare su operazioni e dati prima di avviare l’automatismo.

Il contesto di adozione richiede una verifica preventiva: quali azioni è lecito assegnare all’agente, quali dati servono davvero e chi firma l’approvazione prima di mettere in moto l’automazione nel contesto educativo. OpenClaw propone una transizione graduale da interazione singola a flussi riutilizzabili, ma questa transizione deve essere gestita con regole condivise e responsabilità chiare per evitare attività non autorizzate o errori di esecuzione.

- 3 domande: quali azioni può fare l’agente, quali dati servono e chi conferma prima dell’uso in classe

- Guardrail: bozze sì e decisioni no, l’AI propone ma il docente approva

- Niente dati personali nel pilota: usa dati anonimi e materiali pubblici per evitare rischi evitabili

- Tracciabilità obbligatoria: salva prompt, output, versione dello strumento e motivi della revisione umana

- OpenClaw è open source basato su Peter Steinberger, quindi personalizza solo dopo test su casi reali

- NemoClaw è il riferimento enterprise per sicurezza e privacy: chiedi evidenze sui controlli prima dell’adozione

- Compatibilità hardware: trattala come da verificare con prove tecniche nel vostro contesto

Oltre le linee guida di base, è utile considerare ulteriori aspetti pratici prima di far funzionare l’agente in classe:

- Onboarding e gestione del rischio: definire il processo di onboarding, ruoli, responsabilità, contromisure e piano di rollback in caso di comportamento inatteso

- Audit e tracciabilità avanzata: registrare le interazioni, versioni, motivazioni e accessi per la conformità educativa

- Protezione dei dati: minimizzazione dati, anonimizzazione, conservazione e conformità alle policy scolastiche

- Test di robustezza: eseguire test su casi reali controllati prima della messa in produzione

Infine, nel quadro delle due versioni, OpenClaw open source basato su Peter Steinberger e NemoClaw enterprise per sicurezza e privacy richiedono una valutazione accurata. Secondo Jensen Huang, OpenClaw sarà il prossimo ChatGPT. Tuttavia, in ambito educativo è necessario tradurre questa promessa in criteri di controllo, audit, conformità e responsabilità. Chiedere evidenze sui controlli di sicurezza, sui meccanismi di protezione dei dati e sulla tracciabilità dei flussi è una prassi indispensabile per una adozione consapevole.

Piano in 60 giorni: pilota, policy e adozione ragionata

Trasforma l’annuncio su OpenClaw in un pilota misurabile e controllato, evitando l’uso con dati degli studenti. Quando l’IA diventa agente, gli errori impattano su processi e responsabilità, quindi documenta e fermati subito in caso di azioni inattese.

- Entro 7 giorni scegli 1 caso d’uso didattica o segreteria e definisci un criterio di qualità condiviso

- Ambito: descrivi le azioni consentite e cosa resta manuale (approvazioni, invii, decisioni)

- Output: imposta solo bozze revisionabili, mai decisioni automatiche

- Entro 14 giorni esegui il test con dati anonimi e materiali pubblici, registrando prompt e output

- Valutazione: annota almeno 3 categorie di errori e la gravità per uso in classe

- Confronto: confronta output dell’agente con la versione corretta e misura coerenza

- Entro 30 giorni chiedi al team digitale una verifica di sicurezza e privacy in un ambiente separato

- Mappa dati: chiarisci dove finiscono input, log e output, cloud o locale, e chi può accedere

- Permessi minimi: definisci ruoli, credenziali dedicate e cosa bloccare in caso di anomalie

- Entro 30–45 giorni dirigente e DSGA formalizzano la policy

- Guardrail: bozze sì e decisioni no, divieto dati sensibili e supervisione umana obbligatoria

- Coinvolgimento DPO: valuta la base giuridica quando l’agente esegue azioni oltre il testo

- Entro 60 giorni decidi se estendere l’uso

- Valutazione: misura tempi, qualità e incidenti rispetto ai criteri del pilota

- Regola di stop: se emergono azioni inattese o errori critici, sospendi l’automatismo e torna a controllo umano fino a nuovo test

- Archivio: aggiorna documentazione interna e registro prove (prompt, output, approvazioni)

- Bozze di verifiche e rubriche: obiettivi e criteri, l’agente propone e tu controlli difficoltà, coerenza e livello

- Piani di lezione: durata, sequenza di attività e prerequisiti, poi adattamento al gruppo da parte tua

- Differenziazione: versioni semplificate e estese con vincoli di livello, controllo sempre su accuratezza e accessibilità

- Feedback iniziale: osservazioni “prima bozza” sugli elaborati, il docente riscrive il feedback ufficiale

- Materiali BES/DSA: domande guidate e lessico controllato, verifica di inclusione e comprensione da parte del docente

- Comunicazioni verso le famiglie: bozze email e riepiloghi, revisione tono e contenuti prima dell’invio

- Checklist per attività collegiali: agenda per consigli di classe e punti operativi, partendo da documenti già approvati

- Input senza dati personali o sensibili degli studenti

- Output sempre con revisione umana prima di qualunque uso in classe

- Tracciabilità: salva prompt, istruzioni, versione dello strumento e note delle modifiche

- Scopo limitato: l’agente prepara bozze, non sostituisce giudizio o responsabilità

- Azioni consentite: limita all’essenziale, evita operazioni irreversibili e usa doppio controllo

- Sicurezza accessi: account dedicati, permessi minimi e credenziali gestite dall’istituzione

- Privacy: verifica dove finiscono i dati e con chi vengono condivisi, anche tramite log

- Riuso: stabilisci chi può riutilizzare un agente e per quali classi o contesti

- Esito del test: raccogli errori, tempi e benefici per decidere se scalare

- Incidenti: se compaiono errori o azioni inattese, sospendi automatismo e ripeti il test

Con questa sequenza OpenClaw resta un supporto operativo e non un rischio, perché ogni passaggio è documentato e approvato da persone.

FAQs

OpenClaw, il prossimo ChatGPT: piano pratico per docenti, dirigenti e ATA

Secondo Jensen Huang, OpenClaw è descritto come il prossimo ChatGPT con agenti AI autonomi e poco codice. Per l'uso nelle scuole serve pilota, policy e controllo umano per privacy e responsabilità.

Il piano pratico prevede pilota, policy e controllo umano, con verifica e governance. Le tabelle operative definiscono ruoli e tempistiche per docenti, team digitale/animatore, dirigente/DSGA, DPO e segreteria.

Usare dati anonimi e garantire tracciabilità di prompt e output, con revisione umana prima di ogni uso in classe. Sono previsti guardrail (bozze sì, decisioni no) e ambienti di test separati per l'attività didattica.

OpenClaw è open source basato su Peter Steinberger; NemoClaw è il riferimento enterprise per sicurezza e privacy: chiedi evidenze sui controlli prima dell’adozione.