Il movimento #QuitGPT si è formato negli Stati Uniti per contestare OpenAI e il suo chatbot ChatGPT. La campagna invita gli utenti a interrompere l’uso del servizio e a boicottare l’azienda, coinvolgendo figure pubbliche di rilievo e sollevando questioni etiche e politiche. Si è manifestata ufficialmente durante il 2024, principalmente online e attraverso campagne social, suscitando un ampio dibattito nazionale e internazionale sulla regolamentazione dell’intelligenza artificiale e sulle connessioni tra tecnologia, potere economico e influenza politica.

- Movimento nato negli USA per boicottare ChatGPT di OpenAI

- Coinvolgimento di celebrità e accademici nel dibattito pubblico

- Accuse di finanziamenti politicizzati e mancanza di trasparenza

- Focus su problemi di sicurezza e uso etico dell’IA

- Impatti legali e controversie etiche in corso

Origini e sviluppi del movimento QuitGPT

Negli USA è nato il movimento QuitGPT: una campagna politica contro OpenAI e il suo chatbot. Le sue origini risalgono a una crescente preoccupazione pubblica riguardo alle implicazioni etiche, alla privacy e alla trasparenza nell’utilizzo dell’intelligenza artificiale. Con l’aumento della popolarità di ChatGPT e di altri strumenti simili, molte persone hanno iniziato a interrogarsi su come i dati vengano raccolti e utilizzati, sulla possibilità di dipendenza da queste tecnologie e sui rischi di disinformazione. In questo contesto, il movimento QuitGPT è emerso come risposta collettiva, promuovendo una maggiore consapevolezza e criticità verso le aziende che sviluppano questi strumenti. La campagna ha avuto origine principalmente sui social media, dove utenti e attivisti hanno condiviso testimonianze e motivazioni per smettere di usare i servizi di OpenAI, usando l’hashtag #QuitGPT. Il movimento si è rapidamente diffuso, attirando l’attenzione di opinione pubblica e di media, anche grazie al sostegno di alcune figure pubbliche e influencer. Essi hanno evidenziato come una maggiore responsabilità etica da parte delle aziende tech possa favorire un ambiente tecnologico più trasparente e rispettoso dei diritti degli utenti. La campagna ha quindi rappresentato non solo una protesta, ma anche una richiesta di cambiamento e di maggiore regolamentazione nel settore dell’intelligenza artificiale, stimolando un dibattito pubblico sulle implicazioni sociali di queste innovazioni tecnologiche. Attraverso questa iniziativa, il movimento QuitGPT mira a incentivare una maggior responsabilità da parte delle aziende e a promuovere un utilizzo più consapevole delle tecnologie AI, ponendo le basi per futuri sviluppi più etici e sostenibili.

Come si è sviluppato il movimento

Negli USA è nato il movimento QuitGPT: una campagna politica contro OpenAI e il suo chatbot, ChatGPT. Questo movimento ha avuto un deciso sviluppo attraverso diverse fasi e strumenti, coinvolgendo sia cittadini che figure di spicco nel settore tecnologico e politico. A livello comunitario, sono stati organizzati eventi pubblici e manifestazioni, rivolti a sensibilizzare l’opinione pubblica sui potenziali rischi legati all’uso intensivo di ChatGPT e alle implicazioni etiche della sua diffusione. Parallelamente, sui social media sono stati condivisi numerosi post virali, video esplicativi e interviste con esperti e attivisti, che hanno evidenziato le criticità di ChatGPT, come problemi di privacy, bias algoritmico e dipendenza tecnologica. La campagna ha anche di mira a sensibilizzare sul ruolo dei finanziamenti e delle influenze politiche che, secondo i sostenitori di QuitGPT, sarebbero stati nascosti o mal gestiti da OpenAI, contribuendo a un'apparente distorsione nel suo operato e nelle politiche aziendali. La partecipazione di personalità pubbliche e leader di pensiero ha amplificato il messaggio, creando un effetto di rete che ha spinto il dibattito oltre il mondo tecnico, coinvolgendo anche settori della politica e dell’opinione pubblica. Questo movimento si inserisce in un più ampio contesto di discussione sul progresso tecnologico e responsabilità, promuovendo anche alternative come Google Gemini e Claude di Anthropic, considerate soluzioni più trasparenti e rispettose di principi etici fondamentali. Attraverso questa iniziativa, gli attivisti mirano a stimolare regolamenti più stringenti e una maggiore attenzione alle conseguenze sociali dell’intelligenza artificiale.

Quali sono le principali accuse rivolte a OpenAI

La campagna QuitGPT è diventata un punto di riferimento per le principali accuse rivolte a OpenAI. Gli attivisti sostengono che l'azienda non operi in modo trasparente riguardo alle sue partnership e ai suoi investimenti, alimentando sospetti di favoritismi o influenze occulte. Si evidenzia inoltre come OpenAI possa essere coinvolta in pratiche di lobbying che mirano a indirizzare le politiche pubbliche a favore degli interessi delle grandi corporazioni tecnologiche, a discapito di trasparenza e confronto pubblico. Un altro aspetto contestato riguarda la raccolta e l’utilizzo di dati degli utenti, che, secondo le accuse, potrebbe avvenire senza opportuna consapevolezza o consenso, sollevando dubbi sulla protezione della privacy. Inoltre, alcuni critici evidenziano come le politiche di sviluppo di OpenAI possano favorire esclusivamente le grandi aziende e gli utenti più ricchi, creando un divario digitale che penalizza le fasce più vulnerabili della popolazione. La questione della regolamentazione delle intelligenze artificiali e la mancanza di standard chiari sono altresì fonti di critica, accusando l’azienda di approfittare della propria posizione per esercitare un controllo eccessivo nel settore. Questi fattori alimentano un quadro complesso di accuse che mettono in discussione non solo le pratiche aziendali di OpenAI ma anche l’impatto più ampio delle tecnologie AI sulla società e sulla democrazia negli Stati Uniti.

Il manifesto del boicottaggio e le alternative

Negli USA è nato il movimento QuitGPT: una campagna politica contro OpenAI e il suo chatbot. Il manifesto del boicottaggio evidenzia le preoccupazioni riguardanti le pratiche aziendali di OpenAI, come la gestione dei dati degli utenti e le potenziali influenze politiche sulle risposte generate dall'intelligenza artificiale. Il sito ufficiale di QuitGPT denuncia il supporto finanziario di OpenAI a politiche controverse e invita gli utenti a preferire piattaforme alternative come Gemini di Google o Claude di Anthropic, considerate più trasparenti e meno influenzate da interessi politici e economici. Inoltre, il movimento promuove una maggiore consapevolezza sull'importanza di scegliere strumenti di intelligenza artificiale sviluppati secondo principi etici e di rispetto della privacy, sostenendo una maggiore responsabilità da parte delle aziende del settore.

Implicazioni etiche e sociali

Oltre alle motivazioni politiche, la campagna si concentra anche su aspetti etici: molte persone sono insoddisfatte delle recenti versioni di GPT, come GPT-5.2, descritta come troppo accondiscendente e poco stabile. La diffusione del movimento ha portato a un ampio dibattito sui limiti e le responsabilità dell’IA, evidenziando le fragilità di un settore ancora in fase di regolamentazione.

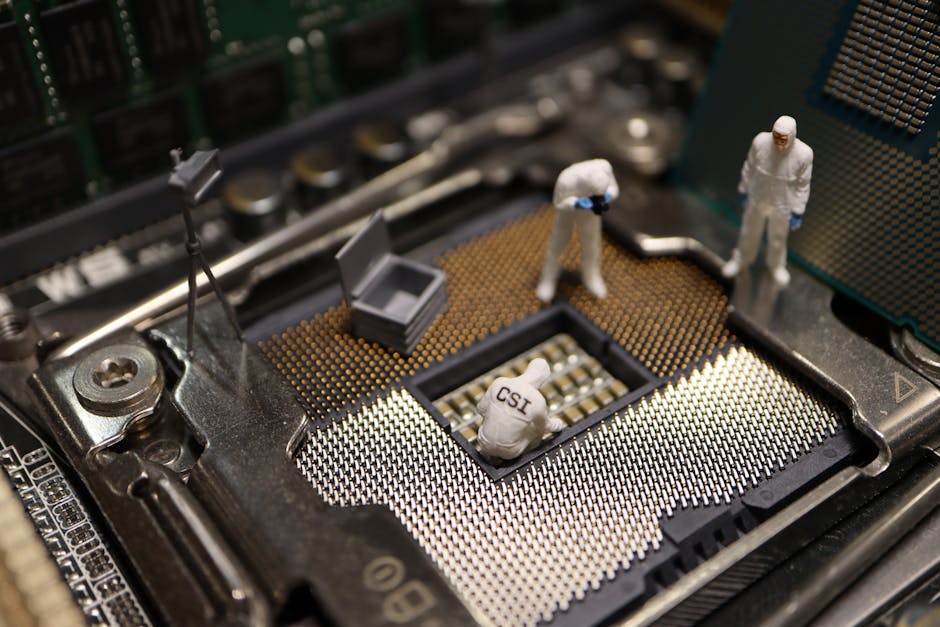

Questioni di sicurezza e uso etico dell’IA

Uno degli aspetti più discussi riguarda l’utilizzo di ChatGPT da parte di agenzie governative, in particolare l’ICE, che ha usato il chatbot in modo che ha sollevato polemiche. L’accusa principale è che l’AI possa contribuire a comportamenti violenti o discriminatori, come nel caso di ricerche sui curricula dei candidati e la morte di cittadini. OpenAI ha smentito queste accuse, precisando che le aziende governative adoperano solo abbonamenti standard e che si mantiene un controllo sulla sicurezza.

Quali sono le problematiche di sicurezza

Le criticità principali riguardano la gestione dei dati sensibili e la possibilità di utilizzo improprio dell’intelligenza artificiale in ambiti governativi e militari. La scommessa è su un equilibrio tra innovazione e tutela dei diritti umani, tema centrale nelle discussioni avviate dal movimento QuitGPT.

Implicazioni legali e le controversie etiche

Il movimento ha anche acceso i riflettori su questioni legali: l’impatto di ChatGPT nei diversi settori e i rischi di abuso o manipolazione. La questione etica rimane al centro del dibattito, con esperti che indicano come sia ancora prematuro valutare a pieno le conseguenze del boicottaggio e le sue ripercussioni sulla regolamentazione dell’AI.

Notizie correlate – Controversie su Google

Nel 2024, un ex dipendente ha accusato Google di aver usato l’Intelligenza Artificiale Gemini, impiegata dall’esercito israeliano, in modo controverso. Questa vicenda sottolinea come le applicazioni dell’AI siano spesso al centro di discussioni politiche ed etiche, evidenziando le sfide di una regolamentazione globale.

FAQs

Negli USA nasce il movimento QuitGPT: una campagna politica contro OpenAI e il suo chatbot — approfondimento e guida

Il movimento QuitGPT è una campagna politica nata negli USA nel 2024 per contestare OpenAI e il suo chatbot ChatGPT, promuovendo il boicottaggio e la regolamentazione dell’AI.

Le motivazioni principali includono preoccupazioni etiche, sulla privacy, sulla trasparenza e sui rischi di dipendenza e disinformazione legati all'uso di ChatGPT e altre IA.

Il movimento si è sviluppato attraverso campagne social, eventi pubblici, testimonianze di esperti e partecipazione di figure pubbliche, evidenziando rischi e pratiche trasparenti di OpenAI.

Le accuse includono trasparenza insufficiente su partnership e investimenti, pratiche di lobbying, gestione dei dati senza consenso e favori alle grandi aziende digitali.

Il manifesto invita a boicottare ChatGPT, a preferire alternative trasparenti come Gemini di Google e Claude di Anthropic, e a promuovere una maggiore responsabilità etica.

Le implicazioni includono il controllo dell'IA, i rischi di comportamenti discriminatori, la gestione dei dati sensibili e il dibattito sulla regolamentazione del settore.

Figure pubbliche e influencer hanno sostenuto il movimento condividendo testimonianze e aumentandone la visibilità, contribuendo a diffondere le preoccupazioni etiche e politiche.

Il movimento suggerisce piattaforme come Gemini di Google e Claude di Anthropic, considerate più trasparenti e conformi a principi etici.

Le controversie riguardano l’uso di ChatGPT in ambiti governativi e militari, rischi di bias, manipolazioni e violazioni della privacy.