Chi: utenti di social media e studenti; Cosa: diffusione di un video fake di una docente che insulta studenti per l’uso di ChatGPT; Quando: recente, diffusione viral; Dove: piattaforme come TikTok; Perché: dimostrare come i contenuti falsi possano sembrare reali e influenzare l’opinione pubblica.

- Un video virale ma falsificato, creato con intelligenza artificiale

- Indicazioni che rivelano la natura artificiale del contenuto

- Diffusione di clip scolastiche generate dall’IA come nuovo fenomeno

Normativa e informazioni su contenuti generati con IA

Destinatari: insegnanti, studenti, genitori e educatori

Modalità: condivisione online, verifiche sui contenuti audiovisivi

Come funziona il video fake realizzato con IA

Il funzionamento di questi video fake con IA si basa su tecnologie avanzate di deepfake e generative adversarial networks (GAN). Questi strumenti analizzano enormi quantità di dati, come immagini, video e suoni di persone reali, per imparare le caratteristiche distintive di volti, movimenti e vocalità. Una volta addestrati, i modelli di intelligenza artificiale sono in grado di generare contenuti video realistici, inserendo figure digitali che parlano, si muovono e manifestano espressioni come se fossero persone reali. Nel caso specifico del video che mostra una docente che urla contro gli studenti, l’IA ha creato una rappresentazione convincente, integrando elementi come la voce, i gesti e le espressioni facciali, tutto senza alcuna ripresa effettiva in aula. Questa tecnologia può essere manipolata facilmente, consentendo di creare scene completamente false che sembrano autentiche, rendendo difficile distinguere se un contenuto sia reale o generato artificialmente. La facilità di accesso a strumenti come Sora AI rende ancora più semplice creare e diffondere fake news, alimentando la disinformazione e complicando il lavoro di chi cerca di distinguere tra realtà e finzione. È importante quindi sviluppare un senso critico e strumenti di verifica affidabili per contrastare la diffusione di questi contenuti falsi.

Le caratteristiche tecniche del video generato con IA

Le caratteristiche tecniche del video generato con IA

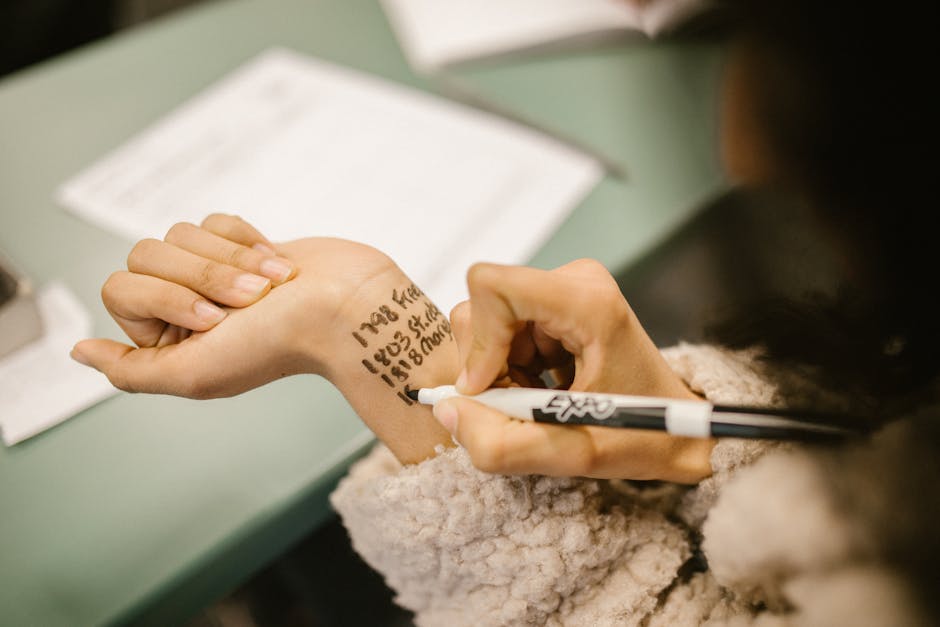

Il video diventato virale, che mostra un docente che urla contro gli studenti che usano ChatGPT, evidenzia molte delle caratteristiche tipiche delle immagini e dei filmati prodotti con intelligenza artificiale. Uno dei segnali più evidenti è rappresentato dalle irregolarità nelle parti del corpo, in particolare nelle mani e nelle braccia della docente. Questi dettagli spesso risultano innaturali o deformi, poiché le tecnologie di generazione di immagini IA ancora faticano a ricreare proporzioni e movimenti muscolari realistici. Inoltre, gli oggetti sui banchi appaiono spesso con forme innaturali, incoerenti tra loro o con proporzioni sbagliate, segnalando un'artificiosità evidente. Anche i volti degli studenti presentano caratteristiche poco realistiche: sfumature poco naturali, deformazioni o sfuocature contribuiscono a generare un senso di distorsione che tradisce l’origine artificiale del video. Tali difetti tecnici sono comunemente riscontrabili nelle creazioni IA, specialmente quando si tratta di sequenze complesse e di dettagli fini.

Questi indicatori sono fondamentali per distinguere un contenuto autentico da uno prodotto artificialmente. La presenza di dettagli visivi incoerenti o poco realistici, associata alla mancanza di fonti verificabili e alla qualità complessivamente bassa rispetto a video reali, aiuta a identificare rapidamente un fake realizzato con IA. È importante sviluppare un occhio critico e riconoscere queste caratteristiche per evitare di cadere víctima di notizie false o manipolate.

Normativa e informazioni su contenuti generati con IA

È importante sottolineare come la diffusione di contenuti generati con intelligenza artificiale abbia sollevato numerosi interrogativi riguardo alla normativa vigente e alla gestione della veridicità delle immagini e dei video condivisi online. In particolare, nel caso del video virale di un docente che urla contro gli studenti che usano ChatGPT, bisogna precisare che si tratta di un falso realizzato mediante tecnologie di deepfake o di generazione di contenuti audiovisivi sintetici. Questi strumenti, sebbene consentano di creare simulazioni realistiche, pongono sfide significative in termini di etica, privacy e affidabilità delle informazioni.

Le normative attualmente in vigore mirano a regolamentare l'uso di contenuti generati da IA, insistendo sulla responsabilità di chi crea e condivide materiali falsi o ingannevoli. È fondamentale che insegnanti, studenti e genitori siano consapevoli dell'esistenza di strumenti di verifica digitale, come i software di analisi dell'autenticità e di detecting dei contenuti sintetici, utili per identificare materiale manipolato. La trasparenza nell'uso di IA e l'educazione alla verifica delle fonti sono elementi chiave per contrastare la diffusione di disinformazione.

La normativa vigente si evolve continuamente, anche in risposta alle nuove tecnologie, e prevede sanzioni per chi utilizza strumenti di intelligenza artificiale per scopi ingannevoli o dannosi. È importante mantenere un dialogo aperto tra istituzioni, insegnanti e studenti per aggiornarsi sulle best practices e rispettare principi etici nel trattamento e nella diffusione di contenuti generati artificialmente. In questo contesto, l’educazione digitale assume un ruolo centrale nel promuovere un uso responsabile delle nuove tecnologie, riducendo il rischio di manipolazioni e fraintendimenti.

Quali sono le implicazioni di contenuti falsi scolastici con IA

Inoltre, l’uso di contenuti falsi basati sull’intelligenza artificiale può portare a conseguenze più profonde nel contesto educativo. Quando video come quello del docente che urla contro gli studenti che usano ChatGPT vengono diffusi come reali, rischiano di alterare la percezione di sicurezza e fiducia negli ambienti scolastici. Questo può influenzare il rapporto tra insegnanti e studenti, creando sospetti o conflitti ingiustificati. È fondamentale promuovere l’alfabetizzazione digitale, affinché tutte le parti coinvolte possano distinguere tra materiale autentico e manipolato, prevenendo la diffusione di fake news e tutelando la reputazione delle istituzioni scolastiche. La sensibilizzazione su questi temi aiuta a sviluppare un approccio critico verso le informazioni veicolate attraverso le nuove tecnologie.

Come riconoscere un video generato con IA

Oltre a riconoscere i segnali visivi di un video generato con IA, è importante prestare attenzione anche ad aspetti audio e comportamentali. I video fake spesso presentano anomalie nei movimenti del volto, nelle espressioni facciali o nelle sincronizzazioni tra voce e bocca, che sembrano innaturali o sforzate. Inoltre, può essere utile controllare se ci sono incoerenze nelle ombre, nelle luci o nei dettagli di sfondo, che possono indicare manipolazioni digitali.

Verificare le fonti originali e cercare conferme da fonti affidabili è un passaggio fondamentale. Se il video si diffonde sui social media, si può controllare la presenza di versioni ufficiali o di comunicati che ne confermino l’autenticità. In ogni caso, mantenere un approccio critico e diffidare dei contenuti troppo sensazionalistici o improvvisamente virali può aiutare a evitare di essere ingannati da video Fake generati con intelligenza artificiale.

FAQs

Il falso virale di un insegnante che urla contro gli studenti che usano ChatGPT: un video creato con IA

No, il video è un falso creato con intelligenza artificiale e tecnologie di deepfake, non rappresenta una scena reale.

Irregolarità nelle mani, deformazioni nei movimenti, dettagli incoerenti e caratteristiche poco realistiche nei volti sono segnali comuni di un video AI falso.

Analizzando dettagli visivi e audio, cercando incoerenze, e verificando le fonti ufficiali e gli elementi di contesto sono modi efficaci per distinguere un fake AI.

Può compromettere la fiducia nelle istituzioni scolastiche, creare sospetti ingiustificati e alterare la percezione di sicurezza tra docenti e studenti.

Difetti come deformazioni nelle mani, oggetti innaturali e caratteristiche poco realistiche nei volti aiutano a riconoscere un contenuto artificiale.

Software di analisi dell’autenticità e di detecting dei contenuti sintetici, oltre a linee guida per la verifica delle fonti, sono strumenti utili.

Promuove la consapevolezza e il senso critico, insegnando come verificare l’autenticità dei contenuti e prevenire la diffusione di fake news.

Prevede sanzioni per chi crea o diffonde contenuti ingannevoli e promuove l’uso responsabile di tecnologie di intelligenza artificiale.