Nasce dall intesa tra Nvidia e Amazon Web Services (AWS). Nvidia venderà ad Amazon un milione di chip per il cloud entro la fine del 2027. Le prime consegne sono previste a breve e continueranno fino al 2027. L obiettivo dichiarato è migliorare resa e qualità dell inferenza, cioè le risposte generate dai modelli AI. Per scuole e dirigenti la ricaduta è indiretta: più capacità nei data center rende gli strumenti online più reattivi.

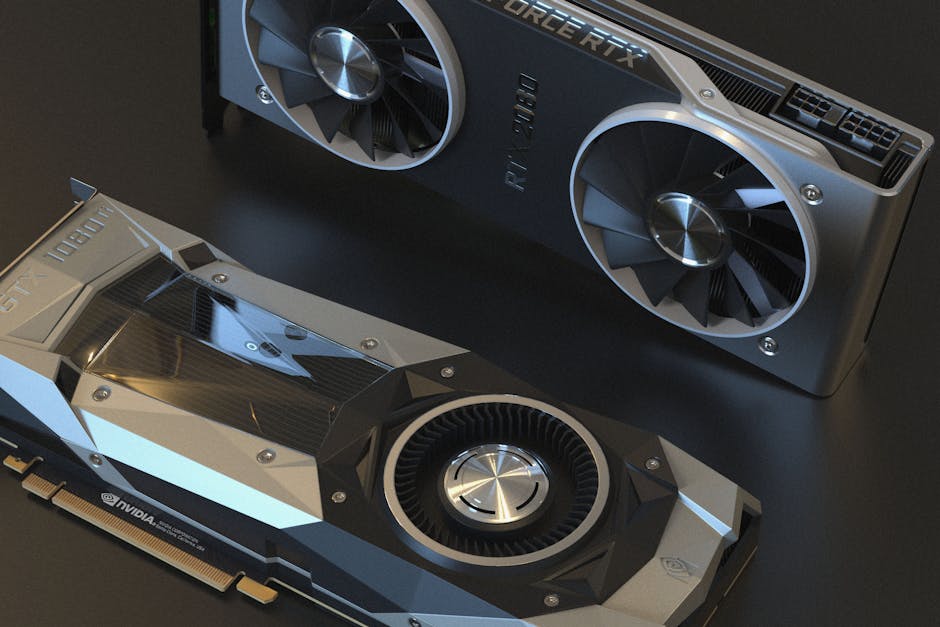

Nvidia venderà ad Amazon un milione di chip per il cloud entro la fine del 2027: come cambia l inferenza AI su Amazon Web Services GPU

- Entro la fine del 2027 AWS riceve un milione di chip GPU. Serviranno a far girare applicazioni AI nel cloud.

- Prime consegne a breve e continuità lungo l arco dell accordo, con un aumento progressivo della capacità.

- Priorità all inferenza AI: l hardware serve a migliorare resa e qualità delle risposte dei modelli, non solo a formarli.

- Un mix con Groq e altri sei modelli riduce i colli di bottiglia. Serve perché l inferenza è complessa e richiede più acceleratori.

- Domanda in crescita: Jensen Huang parla di un aumento computazionale. Dice che è cresciuta di un milione di volte negli ultimi due anni.

- Spinta tecnologica: Nvidia punta su chip Nvidia Blackwell e Rubin. Obiettivo ricavi verso 1.000 miliardi di dollari entro il 2027.

L idea centrale è operativa: più GPU su AWS gestiscono più richieste contemporanee. Così le performance restano più stabili quando l uso dell AI sale. L inferenza è la fase in cui il modello già addestrato produce output per ogni richiesta. Se l infrastruttura regge, chatbot, traduzione automatica e feedback per lo studio tendono a essere più reattivi, soprattutto nei picchi.

Nel frattempo, Nvidia prepara chip ispirati a Groq per accelerare l elaborazione dell AI.

Confini operativi per la scuola: cosa copre l accordo e cosa no

L intesa riguarda forniture per data center, non acquisti diretti della scuola. Gli effetti sulla didattica dipendono dai fornitori dei servizi AI che usate. Dipende anche da come aggiornano infrastruttura e modelli. Se un servizio non migra su nuove risorse, il cambiamento sarà limitato.

Restano inoltre i vincoli su dati personali, consenso e tracciabilità. Conta anche la gestione dei prompt: cosa inserite, chi vede i log, e come avviene l eventuale cancellazione.

Cosa fare in scuola ora per usare l AI su cloud in modo utile e sicuro fino al 2027

Più potenza su AWS tende a migliorare la reattività dell inferenza, soprattutto nei picchi di utilizzo. Non è una garanzia immediata per ogni software, ma offre spazio ai fornitori per ottimizzare tempi di risposta e qualità. La scuola deve quindi preparare processi, non solo scegliere strumenti.

Nel periodo che porta verso fine 2027, fate un controllo su dove e come vengono trattati i dati. Inserite domande sul tipo di inferenza usata e su chi gestisce i backend cloud. Valutate anche SLA di disponibilità e piani di continuità del servizio. Per i servizi che coinvolgono dati degli studenti, la governance deve rimanere ferma anche quando le prestazioni aumentano.

Definite anche criteri misurabili per decidere se un tool AI è davvero efficace. Parametri pratici sono tempo medio di risposta, percentuale di output accettabili dagli studenti e modalità di correzione degli errori. Un aumento di capacità non elimina allucinazioni, bias o contenuti inappropriati: serve una procedura di verifica.

- Mappare gli strumenti AI usati oggi in classe, nella segreteria e nei servizi digitali interni.

- Chiedere informazioni sull hosting al fornitore: dove avviene l inferenza, quali regioni, quali sub-responsabili.

- Rendere controllabili i dati con clausole su conservazione, cancellazione e accessi autorizzati, coerenti con GDPR.

- Fare test con carichi reali su casi scolastici: orari di punta, classi numerose, compiti tipici.

- Standardizzare regole e formazione per docenti e ATA: uso del prompt, verifica output e gestione dei feedback.

Entro 30 giorni: 4 risposte da ottenere prima di estendere l uso dell AI

- Dove gira la piattaforma e in quali regioni sono trattati i dati degli studenti.

- Come avviene l inferenza (modelli, modalità di esecuzione, eventuali motori specializzati).

- Quanto dura la conservazione e come si effettua la cancellazione su richiesta della scuola.

- Che audit e log sono disponibili per controlli interni e verifiche di qualità.

FAQs

Accordo Nvidia e AWS: cosa aspettarsi da un milione di chip GPU entro fine 2027

Informazione non disponibile al 21/03/2026. Al momento non c'è conferma pubblica ufficiale sull'accordo.

L'inferenza è supportata da un mix che comprende Groq, i chip Nvidia Blackwell e Rubin e altri sei modelli. Questo aiuta a ridurre i colli di bottiglia e a gestire scenari complessi di inferenza.

Potenzia la reattività durante i picchi, ma resta cruciale la governance dei dati e la conformità al GDPR; l'efficacia dipende anche dai fornitori dei servizi AI.

Dentro 30 giorni, chiedere quattro informazioni chiave: dove gira la piattaforma e in quali regioni sono trattati i dati e come avviene l'inferenza. Verificare anche la durata/ cancellazione dei dati e quali audit e log sono disponibili.